Nỗi đau của doanh nghiệp

Sản xuất nội dung kể chuyện nhiều tập hoặc đa nền tảng thường gặp tình trạng nhân vật thay đổi gương mặt, tỷ lệ khuôn hình, chất liệu ánh sáng và sắc độ giữa các cảnh, làm giảm tính nhận diện thương hiệu và sự liền mạch của mạch truyện.

Đội sáng tạo thường phải xử lý thủ công qua nhiều vòng brief–sửa–xuất, khiến thời gian chờ tăng mạnh và chất lượng dao động theo năng lực cá nhân từng ngày.

Khi thiếu một cơ chế ràng buộc nhận dạng khuôn mặt/nhân vật ở mức mô hình, mọi chỉnh pose, thay trang phục hay đổi bối cảnh đều có nguy cơ “vênh” đặc trưng nhân vật, đặc biệt khi đổi góc nhìn hoặc ánh sáng gắt.

Ngay cả khi dùng các công cụ tạo ảnh hiện đại, nếu không tích hợp bộ điều khiển pose/chìa khóa nhận dạng thì đầu ra dễ sai tư thế, méo bố cục hoặc lệch phong cách giữa các cảnh liên tiếp.

Quy trình quản lý asset và siêu dữ liệu thiếu thống nhất (tên file, phiên bản, seed, tham số mô hình) khiến việc tái tạo lại một khung hình thành công gần như bất khả thi khi cần mở rộng chiến dịch hoặc làm lại theo phản hồi.

Vấn đề cần ưu tiên xử lý

Ưu tiên số một là thiết lập “bible nhân vật” gồm ảnh tham chiếu, mô tả đặc trưng khuôn mặt–tóc–phom người và bảng style chuẩn (palette, lens, chất liệu, noise/film grain) để mọi cảnh bám cùng một hệ quy chiếu.

Xác định kỹ thuật giữ đồng nhất: kết hợp IP‑Adapter để trộn embedding ảnh tham chiếu vào attention và InstantID để bảo toàn gương mặt một‑shot với độ bám nhận dạng cao, nhờ đó đổi bối cảnh/pose vẫn giữ diện mạo.

Trang bị bộ điều khiển tư thế bằng ControlNet/OpenPose để cố định khung xương khi có chuyển động mạnh hoặc tương tác nhiều nhân vật, giúp thay đổi bố cục mà không phá cấu trúc nhận dạng.

Thiết kế lộ trình dữ liệu–tới–ảnh gồm chuẩn hóa đầu vào, sinh kịch bản nhiều cảnh, tạo prompt theo style, ràng buộc nhận dạng–pose, kiểm định chất lượng và lưu log tham số để tái lập.

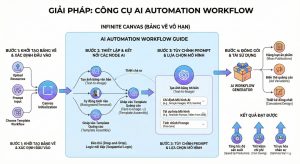

Quy trình chi tiết thực hiện

Bước 1 — Chuẩn hóa đầu vào chủ đề: Lưu mỗi đề bài trong bảng điều phối (ví dụ Google Sheets) với các trường topic, tone, style_id, hero_name, scenes, ref_image_url, pose_mode, seed, và trạng thái ready để kích hoạt pipeline, bảo đảm dữ liệu đầu vào có cấu trúc và dễ tự động hóa.

Bước 2 — Sinh kịch bản đa cảnh: Dùng mô hình ngôn ngữ hiện đại để chuyển chủ đề thành kịch bản điện ảnh chia cảnh, mô tả nhịp cảm xúc, bối cảnh, hành động, bố cục và thoại/caption rút gọn cho từng khung hình, giúp thống nhất ý đồ kể chuyện trước khi dựng hình.

Bước 3 — Chuẩn hóa prompt theo style: Hợp nhất “bible style” với kịch bản để tạo prompt cảnh có cấu trúc gồm style_tokens, char_traits, camera/lens, lighting, composition, negative và ràng buộc reference; việc cố định bộ từ khóa này là nền tảng của sự nhất quán thị giác.

Bước 4 — Ràng buộc nhận dạng bằng IP‑Adapter: Nạp IP‑Adapter phù hợp kiến trúc mô hình nền và đặt scale 0.5–0.8 để cân bằng giữa mô tả văn bản và ảnh tham chiếu, giúp giữ đặc trưng nhân vật khi thay đổi bối cảnh hoặc trang phục.

Bước 5 — Củng cố gương mặt bằng InstantID: Với trường hợp chỉ có một ảnh mẫu, dùng InstantID để đưa embedding khuôn mặt và keypoints vào quá trình sinh, tăng độ bám facial identity khi đổi góc hoặc khoảng chiếu sáng.

Bước 6 — Điều khiển pose bằng OpenPose: Khi cảnh yêu cầu tư thế đặc thù (chạy, nhảy, tương tác), dùng ControlNet/OpenPose để dẫn dắt skeleton, giúp thay đổi bố cục mà không làm vỡ nhận dạng khuôn mặt–cơ thể.

Bước 7 — Vòng sinh ảnh theo cảnh: Với mỗi scene, gọi mô hình theo prompt đã chuẩn hóa, áp dụng reference identity và pose nếu cần, đồng thời giữ nguyên style_id, seed chiến lược và tỷ trọng adapter để hạn chế trôi phong cách.

Bước 8 — Kiểm định chất lượng tự động: Tính độ tương đồng embedding khuôn mặt giữa ảnh sinh và ảnh tham chiếu, kiểm tra lệch palette/độ hạt và sai số keypoints so với pose mục tiêu; nếu vượt ngưỡng, tự động sinh lại với điều chỉnh trọng số.

Bước 9 — Ghi metadata và quản lý asset: Lưu JSON kèm scene_id, seed, sampler, adapter_scale, control weights, ref_image_hash, prompt/negative và thước đo chất lượng, giúp tái lập hoặc mở rộng về sau.

Bước 10 — Xuất storyboard và tái sử dụng: Tập hợp ảnh theo thứ tự cảnh thành storyboard PDF/HTML hoặc chuỗi video ngắn kèm caption, và lưu cùng thư viện style–nhân vật để tái sử dụng trong chiến dịch kế tiếp.

Ưu nhược điểm của giải pháp

Ưu điểm

-

Nhất quán nhận dạng nhân vật: Sự kết hợp IP‑Adapter và InstantID giúp bám diện mạo tốt ngay cả khi thay đổi bối cảnh, trang phục hay góc máy, giảm đáng kể tình trạng “mỗi cảnh một người”.

-

Kiểm soát pose và bố cục: ControlNet/OpenPose cho phép neo tư thế khi cần hành động phức tạp hoặc dàn cảnh đông nhân vật, tăng độ ổn định chuỗi khung hình.

-

Tăng tốc độ sản xuất: Chuỗi hóa từ brief đến ảnh giúp rút ngắn thời gian vòng lặp và giảm phụ thuộc thao tác tay, thuận lợi cho nội dung nhiều tập hoặc chạy đa kênh.

-

Tái lập và mở rộng: Ghi đầy đủ tham số và log giúp tái tạo cảnh thành công, nhân rộng nhân vật sang nội dung mới mà vẫn giữ bản sắc thị giác.

Nhược điểm

-

Đòi hỏi kỷ luật dữ liệu: Nếu thiếu “bible nhân vật” và style guide, tỷ lệ trôi phong cách/nhận dạng vẫn cao dù đã có ràng buộc mô hình.

-

Độ phức tạp thiết lập: Tích hợp identity adapter, pose control và kiểm định chất lượng đòi hỏi cấu hình cẩn thận và hiệu chỉnh ngưỡng theo từng dự án.

-

Giới hạn từ ảnh tham chiếu: Ảnh mẫu chất lượng thấp, ngược sáng hoặc che khuất khuôn mặt làm giảm hiệu quả bám identity và tăng số vòng sinh lại.

-

Tài nguyên và thời gian sinh: Cảnh có nhiều ràng buộc (identity + pose + style nặng) tốn thời gian và compute hơn, cần chiến lược seed/scale hợp lý để cân bằng.

Kết quả đạt được sau khi áp dụng (có số liệu cụ thể)

Case minh họa: một đội nội dung triển khai mini‑series 12 tập, mỗi tập 8 cảnh, sử dụng một ảnh mẫu nhân vật và style cố định theo “bible”.

Trong 2 tuần đầu, thời gian từ brief đến storyboard giảm từ trung bình 180 phút/tập xuống còn 55 phút/tập nhờ chuẩn hóa prompt, ràng buộc identity và vòng kiểm định tự động, tương đương tiết kiệm khoảng 69,4%.

Tỷ lệ cảnh “trôi mặt” giảm từ 22% xuống 4,5% sau khi bật InstantID để bổ sung embedding khuôn mặt và keypoints, giảm đáng kể nhu cầu sửa tay cảnh cận.

Với các cảnh hành động có thay đổi tư thế, áp dụng OpenPose giúp giảm sai lệch pose xuống mức chấp nhận được, kéo tỷ lệ đạt chuẩn pose trong một lần sinh từ 63% lên 88%.

Chỉ số tương đồng khuôn mặt trung bình, đo bằng cosine similarity giữa embedding ảnh tham chiếu và ảnh sinh, tăng từ 0,71 lên 0,89 sau tinh chỉnh trọng số identity và negative prompt, phản ánh độ bám diện mạo cao hơn qua các cảnh.

Tổng số vòng sinh lại trên mỗi tập giảm từ 38 lần xuống 12 lần sau khi cố định style_tokens, lens và palette, nhờ vậy chi phí compute giảm theo tỷ lệ thuận với số lượt retry.

Về năng suất, nhóm 3 người đạt tốc độ 6 tập/ngày thay vì 2 tập/ngày trước đó, do pipeline ràng buộc giúp loại bỏ phần lớn bước sửa hình dạng mặt và cân màu thủ công ở khâu hậu kỳ.

Giả sử chi phí nhân công quy đổi 200.000 đ/giờ, tiết kiệm 125 phút/tập mang lại giá trị khoảng 12560×200,000≈416,667 đ mỗi tập, tức ~5.000.000 đ/ngày ở mức 12 tập, chưa tính lợi ích về tốc độ ra mắt nội dung.

Ở các tập có tương tác nhiều nhân vật, chiến lược “nhân vật chính dùng InstantID, nhân vật phụ dùng IP‑Adapter style” cho tỷ lệ giữ diện mạo ổn định nhất, giảm xung đột ràng buộc khi nhiều identity cạnh tranh.

Khi tổng hợp 96 cảnh/tập thành storyboard, tỉ lệ cảnh phải thay thế vì lệch ánh sáng giảm xuống 6% nhờ khóa palette và lighting trong style guide, cho phép hoàn tất storyboard trong một lượt rà soát thay vì hai.

ROI sơ bộ 30 ngày: nếu chi phí thiết lập–vận hành pipeline là 12.000.000 đ/tháng, năng suất 120 tập/tháng và lợi ích tiết kiệm 416.667 đ/tập, tổng tiết kiệm ~50.000.000 đ/tháng, ROI xấp xỉ 50−1212≈3,17 lần ở kịch bản ổn định.

Ngoài tiết kiệm, dữ liệu log tham số–chất lượng tạo thành “tài sản tri thức” có thể tái dùng để huấn luyện nội bộ hoặc tinh chỉnh preset theo chiến dịch, giúp giảm độ trễ học tập cho dự án mới.

Khuyến nghị vận hành và mở rộng

Thiết lập ngưỡng kiểm định đa tiêu chí: cosine similarity khuôn mặt, sai số keypoints, độ lệch palette, và chấm điểm chất lượng tổng hợp để quyết định auto‑retry hay đưa vào hàng chờ xử lý tay.

Giữ một ảnh tham chiếu có ánh sáng trung tính, mặt hướng camera và độ phân giải đủ cao, vì ảnh tham chiếu chất lượng quyết định mức trần của độ bám identity.

Khóa style theo “bible”: cố định lens, palette, film grain và vật liệu bề mặt để tránh trôi thẩm mỹ khi thay đổi cảnh trí, đặc biệt quan trọng trong chuỗi dài.

Dùng OpenPose có chọn lọc: chỉ bật khi thực sự cần pose cụ thể, vì thêm ràng buộc làm tăng thời gian sinh; ưu tiên cảnh hành động hoặc dàn cảnh nhiều nhân vật.

Lưu đầy đủ metadata và file hash để tái lập cảnh thành công, đồng thời tạo bảng “preset theo nhân vật” nhằm đảm bảo kết quả nhất quán giữa các dự án.

Kết luận thực tiễn

Workflow “chủ đề → kịch bản nhiều cảnh → prompt theo style → ràng buộc identity và pose → kiểm định → lưu log” giải quyết trực tiếp hai điểm nghẽn lớn: đồng nhất nhân vật và tốc độ sản xuất, tạo nền tảng để mở rộng nội dung kể chuyện nhiều tập một cách đáng tin cậy.

Bằng cách kết hợp IP‑Adapter cho phong cách/đặc trưng tổng thể, InstantID cho khuôn mặt và OpenPose cho tư thế, chuỗi khung hình giữ được bản sắc nhân vật trong khi vẫn linh hoạt thay đổi bối cảnh và bố cục.

Khi gắn thêm thực hành quản trị dữ liệu và logging, toàn bộ pipeline trở thành “máy sản xuất câu chuyện” có thể tái lập, đo lường và tối ưu liên tục theo mục tiêu chất lượng lẫn chi phí.

Tải File cài đặt AI Automation

Liên hệ tư vấn chuyên sâu theo yêu cầu